Пробивът на DeepMind: Когато машината започна да „вижда“ игрите

Революцията на Atari 2600

През 2013-2015 г. екипът на DeepMind (днес част от Google) публикува епохални изследвания, които доказаха, че един изкуствен интелект може да се научи да играе сложни видеоигри на ниво по-високо от човешкото.

Те използваха 49 класически игри за конзолата Atari 2600. Важното тук е, че ИИ нямаше достъп до вътрешния код на играта – той получаваше само суровите пиксели от екрана и текущия резултат. Резултатът? Машината не само се научи да играе, но в много от игрите откри стратегии, за които хората дори не бяха подозирали.

Deep Q-Network (DQN): Обединението

Ключът към този успех беше внедряването на Deep Q-Network (DQN). Това е архитектура, която съчетава:

-

Reinforcement Learning (Обучение чрез подсилване): ИИ се учи чрез награди (точки) и наказания (загуба на живот).

-

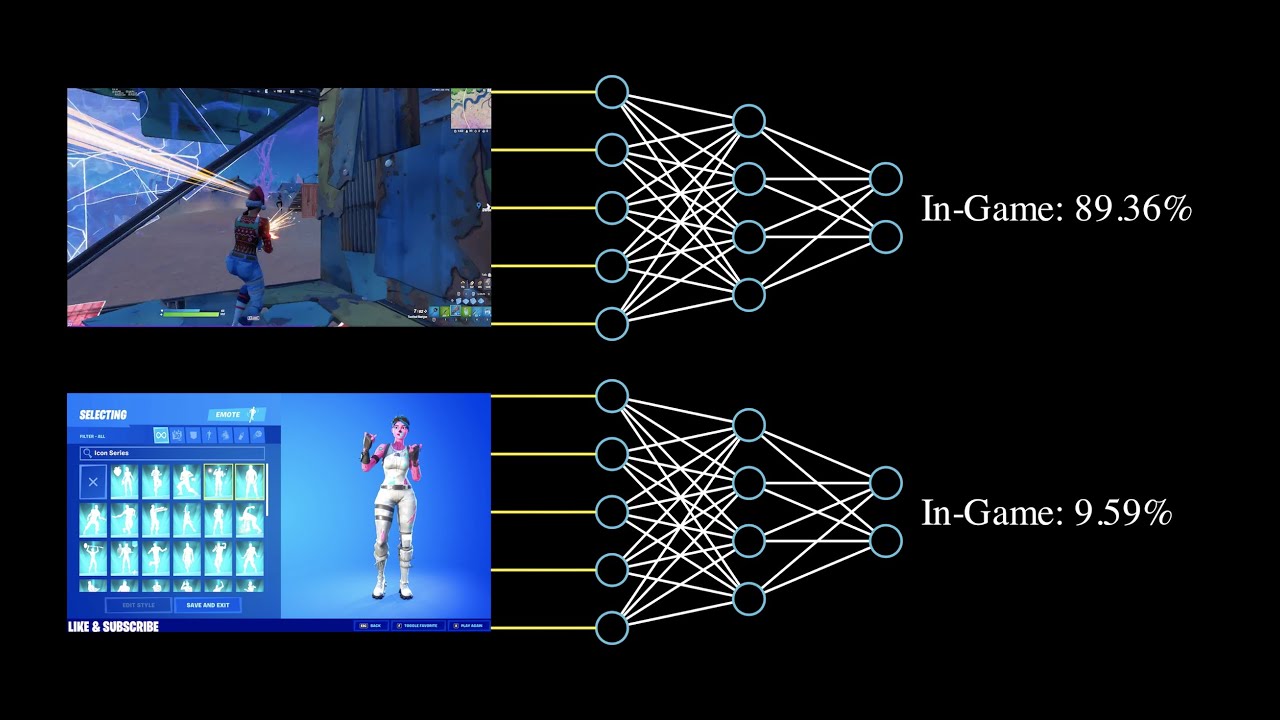

Deep Learning (Дълбоко обучение): Използват се конволюционни невронни мрежи (CNN), които позволяват на агента буквално да „вижда“ обектите на екрана – топчето в Breakout, враговете в Space Invaders или тухличките.

Отвъд видеоигрите: Пътят към AlphaGo

Успехът с Atari игрите беше само началото. DeepMind доказаха, че същите принципи на General Game Playing могат да се приложат и към най-сложните интелектуални предизвикателства пред човечеството. Вместо да се програмират специфични правила за всяка задача, се създава общ алгоритъм, който се подобрява сам чрез натрупване на опит. Това проправи пътя към легендарните победи над световните шампиони в играта Го (AlphaGo) и шахмата (AlphaZero).

Защо това е важно за GGP?

Пробивът на DeepMind превърна General Game Playing от теоретична концепция в работеща реалност. Той показа, че с достатъчно изчислителна мощ и правилна архитектура на невронната мрежа, можем да създадем системи, които се адаптират към всяка визуална среда.